L’implementazione di modelli di machine learning sta rivoluzionando settori come l’e-commerce, la finanza e la logistica; tuttavia, una significativa percentuale di questi progetti non riesce a superare l’ultimo ostacolo: la fase di produzione. In questo contesto, l’MLOps engineer assume un ruolo fondamentale.

Solo il 10–20% dei progetti arriva effettivamente in produzione e oltre il 90% dei modelli in produzione degrada nel tempo. Senza processi operativi robusti, modelli eccellenti restano confinati nei notebook dei data scientist o smettono di funzionare correttamente dopo pochi mesi. Qui entra in gioco l’MLOps engineer, un professionista ibrido che combina competenze di machine learning, DevOps e cloud per colmare il “last mile” dell’AI.

Perché il mercato cerca MLOps engineer

La forte spinta all’industrializzazione dell’AI ha fatto esplodere il mercato MLOps: secondo analisi di settore, valeva 2,43 miliardi di dollari nel 2025 e potrebbe superare 56 miliardi entro il 2035, con un tasso di crescita annuo vicino al 37%. Il Nord America detiene circa il 36% del mercato, mentre l’Asia‑Pacifico guida l’espansione. In Europa la crescita è più lenta per via della regolamentazione e dei requisiti di governance, ma le aziende stanno implementando soluzioni MLOps per garantire compliance.

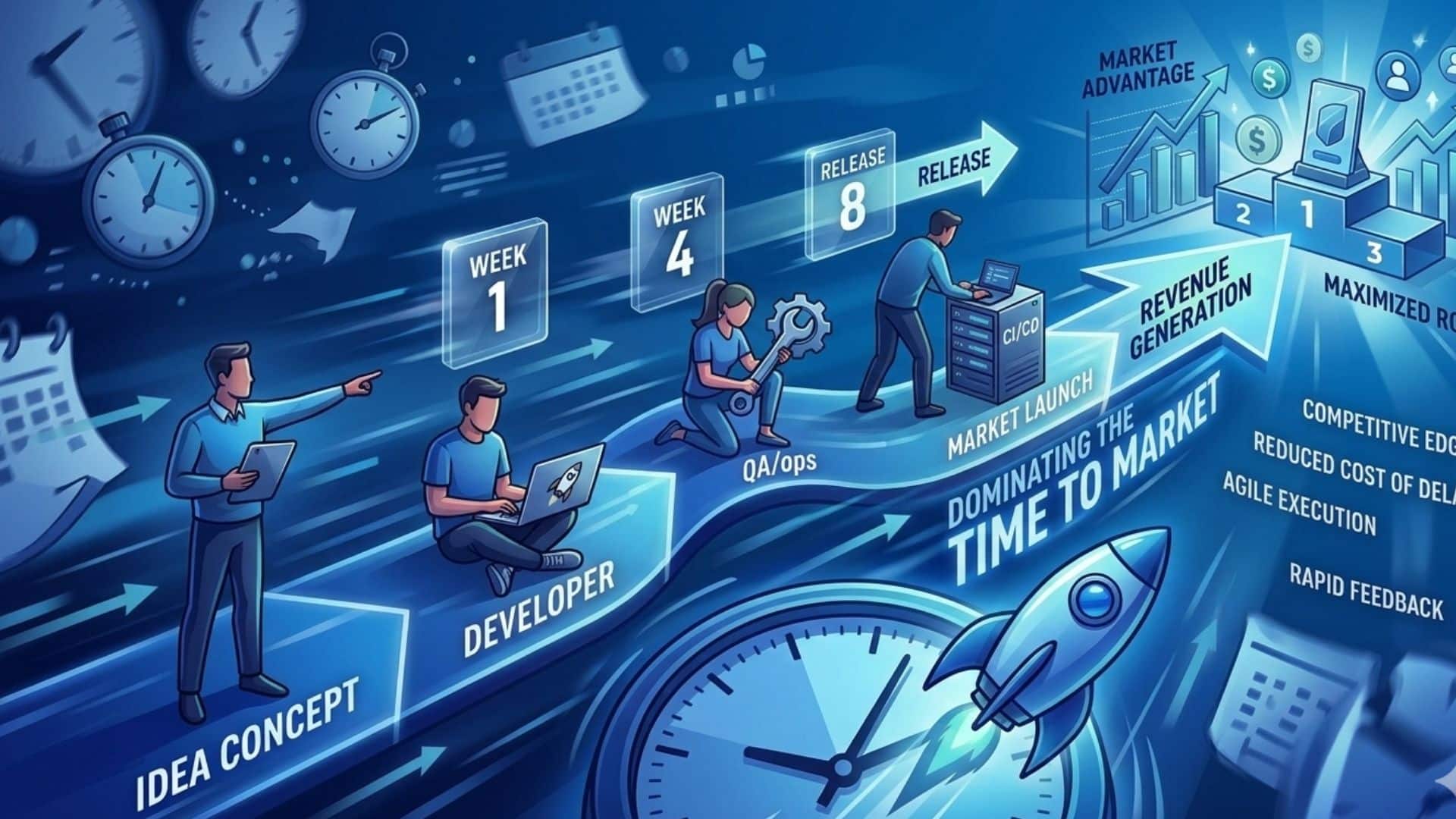

Questa dinamica è alimentata da fattori convergenti: l’adozione massiccia dell’AI in finanza, sanità e retail, la necessità di automatizzare l’intero ciclo di vita del modello e il gap tra prototipi e applicazioni reali che solo pratiche MLOps riescono a colmare. Inoltre, la maturità dei servizi cloud e l’integrazione con le metodologie DevOps facilitano la standardizzazione di pipeline e infrastrutture, riducendo il time‑to‑market e i rischi operativi.

Panoramica globale degli stipendi e competenze

Le retribuzioni riflettono la scarsità di professionisti capaci di unire competenze di ML e di ingegneria del software. Negli Stati Uniti un MLOps engineer guadagna tipicamente tra 132.000 e 199.000 dollari l’anno, con una mediana di circa 161.000 dollari. In India, secondo una guida alle carriere, un entry‑level percepisce 6–10 lakh di rupie, un profilo intermedio 10–20 lakh e un senior 20–35 lakh, con punte che arrivano a 36–60 lakh.

In Europa i salari sono più contenuti rispetto agli USA ma superiori a molte regioni asiatiche; variano da paese a paese e dipendono dal costo della vita e dalla densità dell’ecosistema tech. La concorrenza con le big tech rende difficile trattenere i talenti, ma la crescente attenzione alla governance e all’etica dell’AI sta spingendo verso pacchetti più competitivi.

Più che i numeri assoluti, la rarità del profilo si deve alla combinazione di competenze richieste. Oltre a padroneggiare framework ML, un MLOps engineer deve conoscere version control, CI/CD, Infrastructure as Code, almeno un provider cloud e i principi di sicurezza. La containerizzazione con Docker e l’orchestrazione Kubernetes assicurano portabilità e scalabilità. Fattori come località, settore e scala del progetto influenzano la retribuzione: i tech hub pagano fino al 50% in più e settori regolamentati come finanza o sanità offrono compensi superiori. Chi gestisce l’intero ciclo di vita del modello è valutato maggiormente rispetto a chi si occupa di una sola fase.

Stack tecnologico tipico di un MLOps engineer

Il cuore del lavoro dell’MLOps engineer è la costruzione di pipeline end‑to‑end che trasformino i dati grezzi in modelli pronti per la produzione e ne mantengano le prestazioni. Una pipeline completa copre la raccolta dati, l’addestramento, la valutazione, il deployment e il monitoraggio con meccanismi di riaddestramento automatico. Questo approccio riduce errori manuali e garantisce coerenza tra sviluppo e produzione.

Infrastruttura: container e orchestrazione

Per garantire portabilità e scalabilità, i modelli vengono impacchettati in container Docker e orchestrati su Kubernetes, che gestisce il deployment su cluster multi‑cloud e l’auto‑scaling. Gli strumenti open source più diffusi includono MLflow per tracciare esperimenti e versionare i modelli, Kubeflow (o TFX) per orchestrare pipeline su Kubernetes e KServe o Seldon per esporre modelli come servizi. Per il monitoraggio e l’osservabilità si integrano Prometheus, Grafana o Evidently AI. La scelta dipende dalla dimensione del team, dall’adozione di Kubernetes, dalla strategia cloud e dal budget.

Come l’outsourcing consente di accedere a skill senior

Trovare MLOps engineer esperti è complicato. Da un lato la domanda è elevata; dall’altro la combinazione di competenze richieste è rara e ben remunerata. Le aziende che non possono competere con i pacchetti offerti dalle big tech rischiano di rinunciare a progetti AI strategici o di accettare compromessi sulla qualità. È qui che l’outsourcing può diventare un alleato: affidare a un partner esterno parte delle attività MLOps consente di beneficiare immediatamente di competenze senior senza processi di selezione prolungati.

Con un provider esterno si riduce il time‑to‑market perché infrastrutture e pipeline sono già pronte. L’outsourcing trasforma i costi fissi di assunzione in costi variabili e permette di accedere a best practice senza lunghe campagne di recruiting. In genere si adottano tre modelli: il full outsourcing, in cui il partner gestisce l’infrastruttura e il monitoraggio; il modello ibrido, in cui l’azienda mantiene il controllo sul core del modello ma delega l’infrastruttura; e la consulenza, che aiuta a costruire una piattaforma su misura trasferendo know‑how al team interno. I rischi principali riguardano la proprietà intellettuale, la privacy dei dati e il potenziale lock‑in: è quindi importante definire con chiarezza ruoli, SLA e clausole di uscita e, nei settori regolamentati, preferire modelli che mantengano il controllo sulle parti sensibili.

Come integrare l’MLOps in azienda

La crescita esplosiva del mercato MLOps e la difficoltà a portare in produzione i modelli ML rendono questa professione essenziale per chiunque voglia generare valore reale dall’AI. Tuttavia, la carenza di talenti e gli stipendi elevati spingono molte aziende a valutare l’outsourcing o modelli ibridi per accedere rapidamente alle competenze necessarie.

Ecco tre suggerimenti applicabili subito per integrare questa figura in azienda:

Analizzare il gap tra prototipo e produzione: monitorate quante sperimentazioni ML passano in produzione e quanto tempo richiedono; se la maggior parte resta bloccata, è ora di introdurre pratiche MLOps o di affidarsi a specialisti.

Costruire uno stack modulare: partite con strumenti open source come MLflow, Airflow o Kubeflow e valutate piattaforme gestite solo quando avete bisogno di scalare rapidamente; evitate soluzioni monolitiche che creano lock‑in.

Valutare l’esternalizzazione con equilibrio: l’outsourcing può accelerare il progetto e ridurre i costi iniziali, ma richiede attenzione a proprietà intellettuale, privacy e governance. Un modello ibrido spesso offre il miglior compromesso tra velocità e controllo.

Adottare queste strategie può migliorare significativamente l’efficacia dei progetti ML, garantendo un equilibrio tra innovazione e controllo.